以高质量搜索 API 著称的 Exa 公司,近期推出了其最具雄心的产品:深度研究智能体(Deep Research Agent)。该智能体能够自主探索互联网,直至挖掘出用户所需的结构化信息。

本案例研究将深入探讨 Exa 的工程团队如何利用 LangGraph 构建一套具备生产能力的分布式智能体系统。这套系统每日处理数百次研究查询,并根据任务复杂度,在 15 秒至 3 分钟内交付结构化分析结果。

迈向智能体化搜索的演进

Exa 并非起步于智能体化搜索,而是经历了从单一工具到复杂系统的自然演进。公司最初提供搜索 API,随后进阶到结合了大语言模型(LLM)推理能力的答案接口。最终,他们推出了深度研究智能体——这是其首款真正意义上的智能体化搜索 API。

这一转变映照了整个行业的宏观趋势:大语言模型应用正日益趋向于智能体化与长时程化。在研究领域,这体现为从简单的检索增强生成(RAG)进化为“深度研究”;在编程领域,则表现为从自动补全、问答,转向异步执行、长效运行的编程智能体。

这种演进同时也在重塑团队对开发框架与工具的认知。长期以来,我们通过广受欢迎的开源集成与 Exa 团队保持着紧密合作,但直到现在才在产品层面达成深度共识。Exa 最初的答案接口并未使用特定框架,但在向更复杂的深度研究架构转型时,他们经过严谨评估,最终选择了 LangGraph。这再次印证了一个普遍规律:随着架构复杂度提升,LangGraph 愈发成为构建此类系统的首选框架。

多智能体架构设计

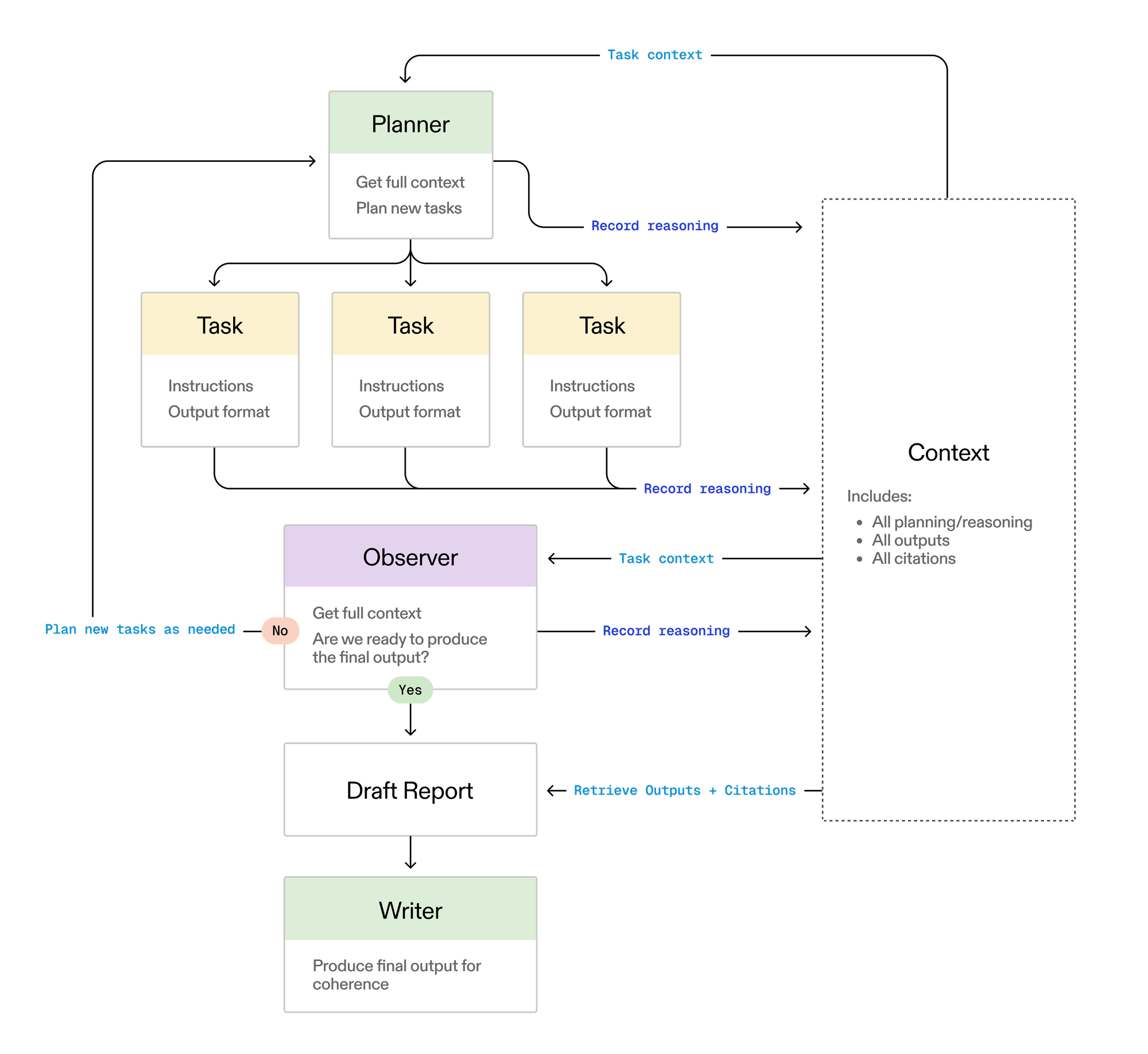

Exa 的研究智能体基于 LangGraph 构建了一套精密的协作模式:

- 规划者(Planner):解析研究查询,动态生成多个并行的研究任务。

- 执行任务(Tasks):独立的研究单元,能够调用专用工具并进行自主推理。

- 观察者(Observer):在整个规划、推理、产出及引用过程中维持全局上下文。

Exa 架构的一个核心洞察在于其刻意的上下文工程(Intentional Context Engineering)。虽然观察者对所有组件具备全量可见性,但单个任务仅接收来自其他任务的最终清洗产物,而非中间的推理状态。

与僵化的工作流不同,Exa 系统会根据查询的复杂度动态调节研究任务的数量。每个任务都会收到:

- 具体的任务指令。

- 强制要求的输出格式(恒定为 JSON Schema)。

- 专用 Exa API 工具的访问权限。

这种灵活性使系统既能应对简单的单点查询,也能扩展到需要大规模并行调查的复杂多面研究。

智能体蓝图的持续进化

Exa 的许多设计决策与 Anthropic 的深度研究系统 异曲同工。这并非巧合。Exa 团队深入研读了那份报告,并从中汲取了大量灵感。

在这些经验之上,Exa 提出了几项关键的优化决策:

搜索片段 vs. 网页全文

Exa 系统中最有趣的上下文工程案例之一是其对搜索内容的处理。系统并非盲目抓取全网页内容,而是首先尝试基于搜索片段(Snippets)进行推理。

这种方法在保证研究质量的同时,显著降低了 Token 消耗,因为智能体仅在片段信息不足时才会请求全文内容。这种在搜索片段与全文结果间灵活切换的能力,正是由 Exa API 原生驱动的。

结构化输出

与许多产出非结构化报告的研究系统不同,Exa 的智能体在每一个层级都维持着结构化的 JSON 输出,且输出格式可在运行时动态指定。

这一决策源于 Exa 对智能体使用场景的预判。不同于面向普通用户的研究工具,Exa 专门针对 API 调用进行了系统设计。在 API 调用场景下,可靠且可解析的输出格式比什么都重要。这种结构化输出主要通过函数调用(Function Calling)技术实现。

利用 LangSmith 实现生产级可观测性

对于 Exa 而言,LangSmith 最核心的价值在于可观测性,尤其是对 Token 使用情况的精准掌控。

“LangSmith 提供的可观测性——特别是对 Token 用量的深度理解——至关重要。而且它的配置极其简便。” —— Mark Pekala,Exa 软件工程师。

对 Token 消耗、缓存率以及推理 Token 用量的透明化监控,为 Exa 制定生产定价模型提供了必要依据,并确保了系统在大规模运行时的成本效益与性能平衡。

结语

Exa 的深度研究智能体完美诠释了 LangGraph 如何在生产环境中赋能复杂的多智能体系统。通过结合 LangGraph 的协调能力与 LangSmith 的可观测性,Exa 构建了一套能够以惊人的速度与可靠性处理真实客户需求的系统。

对于构建类似系统的团队,以下是几点核心启示:

- 可观测性先行:Token 追踪与系统可见性是生产部署的命脉。

- 为可复用而设计:架构合理的智能体流可以同时驱动多条产品线。

- 优先考虑结构化输出:API 用户需要可靠且易于解析的结果。

- 动态任务生成:灵活的任务创建机制比固定工作流更具扩展性。

随着智能体生态的持续演进,Exa 的实践为构建能够创造真实商业价值的生产级智能体系统提供了一个引人入胜的范例。

欲了解更多关于使用 LangGraph 构建多智能体系统的信息,请访问文档 langchain-ai.github.io/langgraph。如需体验 Exa 的深度研究 API,请访问 exa.ai。